- Предвзятый Алгоритм: Скрытый Враг Справедливости и Равенства?

- Что такое предвзятость алгоритмов?

- Источники предвзятости

- Влияние на группы риска

- Примеры предвзятости алгоритмов в реальной жизни

- Как бороться с предвзятостью алгоритмов?

- Что могут сделать разработчики алгоритмов?

- Что могут сделать политики?

- Что можем сделать мы, как потребители?

Предвзятый Алгоритм: Скрытый Враг Справедливости и Равенства?

Мы живем в эпоху, когда алгоритмы правят бал. Они решают, какую рекламу мы видим, какую музыку слушаем и даже, кому дадут кредит или работу. Но что происходит, когда эти алгоритмы не нейтральны? Что, если в их код вшиты предубеждения, которые дискриминируют определенные группы населения? Это не просто теоретический вопрос. Это реальная проблема, с которой мы сталкиваемся сегодня, и она требует нашего внимания.

Мы, как потребители и граждане, должны понимать, как работают эти системы, и требовать большей прозрачности и ответственности от тех, кто их разрабатывает и использует. Ведь на кону стоит не только наша личная жизнь, но и будущее справедливого и равноправного общества.

Что такое предвзятость алгоритмов?

Предвзятость алгоритмов – это систематические ошибки в компьютерных системах, которые создают несправедливые или дискриминационные результаты. Эти ошибки могут быть результатом предвзятых данных, недостаточного разнообразия в командах разработчиков или даже непреднамеренных последствий проектирования алгоритма. Важно понимать, что алгоритмы не рождаются в вакууме; они отражают ценности и предубеждения тех, кто их создает.

Представьте себе алгоритм, который используется для отбора кандидатов на работу. Если исторические данные, на которых он обучен, отражают гендерное неравенство в определенной отрасли, алгоритм может неосознанно отдавать предпочтение мужчинам, даже если женщины так же квалифицированы. Это пример того, как предвзятость в данных может привести к дискриминации.

Источники предвзятости

Существует несколько основных источников предвзятости в алгоритмах:

- Предвзятые данные: Алгоритмы обучаются на данных, и если эти данные содержат предубеждения, алгоритм их унаследует.

- Предвзятые люди: Разработчики алгоритмов могут неосознанно привносить свои собственные предубеждения в процесс проектирования.

- Неполные данные: Отсутствие репрезентативных данных для определенных групп населения может привести к тому, что алгоритм будет работать хуже для этих групп.

- Неправильная интерпретация данных: Ошибочное понимание взаимосвязей в данных может привести к созданию алгоритмов, которые усиливают существующее неравенство.

Влияние на группы риска

Предвзятость алгоритмов оказывает непропорционально большое влияние на группы риска, такие как расовые и этнические меньшинства, женщины, люди с ограниченными возможностями и представители ЛГБТК+ сообщества. Эти группы уже сталкиваются с дискриминацией в различных сферах жизни, и предвзятые алгоритмы могут усугубить эту ситуацию.

Например, исследования показали, что алгоритмы, используемые в системе уголовного правосудия, часто предвзяты по отношению к афроамериканцам, что приводит к более суровым приговорам и большему количеству арестов. В сфере здравоохранения, алгоритмы, предназначенные для оценки потребностей пациентов, могут недооценивать потребности чернокожих пациентов, что приводит к недостаточному лечению.

«Технологии не нейтральны. Они отражают ценности и предубеждения тех, кто их создает.» ⸺ Кэти О’Нил, автор книги «Оружие математического уничтожения»

Примеры предвзятости алгоритмов в реальной жизни

К сожалению, примеры предвзятости алгоритмов встречаются все чаще. Вот лишь несколько случаев:

- Распознавание лиц: Многие системы распознавания лиц хуже распознают лица темнокожих людей, что приводит к ошибочным арестам и другим негативным последствиям.

- Кредитные рейтинги: Алгоритмы, используемые для оценки кредитоспособности, могут дискриминировать людей, живущих в бедных районах, даже если они имеют хорошую кредитную историю.

- Реклама вакансий: Алгоритмы, используемые для показа рекламы вакансий, могут ограничивать возможности для женщин и представителей меньшинств, показывая им рекламу только определенных типов работ.

Как бороться с предвзятостью алгоритмов?

Борьба с предвзятостью алгоритмов – это сложная, но необходимая задача. Она требует усилий со стороны всех заинтересованных сторон, включая разработчиков алгоритмов, политиков, исследователей и потребителей.

Что могут сделать разработчики алгоритмов?

- Собирать репрезентативные данные: Убедитесь, что данные, на которых обучаются алгоритмы, представляют все группы населения.

- Использовать разнообразные команды разработчиков: Включайте в команды разработчиков людей с разным опытом и точками зрения.

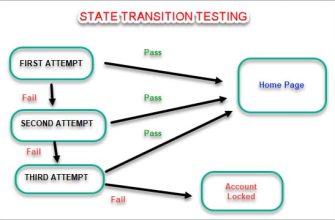

- Проводить тестирование на предвзятость: Регулярно тестируйте алгоритмы на предмет предвзятости и принимайте меры по ее устранению.

- Быть прозрачными: Объясняйте, как работают алгоритмы и как они принимают решения.

Что могут сделать политики?

- Разрабатывать нормативные акты: Создавать законы и правила, которые обязывают компании обеспечивать справедливость и прозрачность алгоритмов.

- Финансировать исследования: Поддерживать исследования в области предвзятости алгоритмов и способов ее устранения.

- Повышать осведомленность: Информировать общественность о проблеме предвзятости алгоритмов и ее последствиях.

Что можем сделать мы, как потребители?

- Задавать вопросы: Спрашивайте компании о том, как они используют алгоритмы и какие меры принимают для предотвращения предвзятости.

- Поддерживать компании, которые борются с предвзятостью: Покупайте продукты и услуги у компаний, которые демонстрируют приверженность справедливости и равенству.

- Распространять информацию: Рассказывайте своим друзьям и семье о проблеме предвзятости алгоритмов.

Предвзятость алгоритмов – это серьезная проблема, которая угрожает справедливости и равенству в нашем обществе. Мы не можем позволить алгоритмам увековечивать и усиливать существующие предубеждения. Мы должны работать вместе, чтобы создать более справедливые и прозрачные алгоритмы, которые служат интересам всех людей.

Давайте помнить, что технологии должны служить нам, а не наоборот. Мы должны быть активными участниками процесса создания и использования алгоритмов, чтобы обеспечить их соответствие нашим ценностям и принципам.

Подробнее

| Алгоритмическая дискриминация | Предвзятость машинного обучения | Справедливость алгоритмов | Этика искусственного интеллекта | Влияние алгоритмов на общество |

|---|---|---|---|---|

| Группы риска и алгоритмы | Прозрачность алгоритмов | Тестирование алгоритмов на предвзятость | Регулирование алгоритмов | Последствия предвзятых алгоритмов |