- Раскрываем «Черный Ящик»: Как сделать модели регуляторов прозрачными и понятными

- Почему «Черный Ящик» – Это Проблема?

- Основные Подходы к Созданию Прозрачных Моделей

- Интерпретируемые Модели: Простота и Понятность

- Методы Объяснимого ИИ (XAI): Раскрываем Скрытое

- Визуализация Данных: Смотрим на Проблему с Другой Стороны

- Аудит Моделей: Регулярная Проверка Здоровья

- Практические Советы по Созданию Прозрачных Регуляторов

- Примеры из Реальной Жизни

Раскрываем «Черный Ящик»: Как сделать модели регуляторов прозрачными и понятными

В мире алгоритмов и автоматизации все чаще сталкиваемся с системами‚ решения которых нам сложно понять. Эти системы‚ часто называемые «черными ящиками»‚ принимают решения на основе сложных вычислений‚ скрытых от нашего взгляда. В контексте регуляторов‚ это может быть особенно проблематично. Как мы можем доверять системе‚ если не понимаем‚ как она работает? Как мы можем ее улучшить‚ если не видим ее внутреннюю логику? В этой статье мы рассмотрим стратегии и методы‚ позволяющие сделать модели регуляторов более прозрачными и понятными.

Почему «Черный Ящик» – Это Проблема?

Представьте себе ситуацию‚ когда автоматизированная система управления производственной линией внезапно останавливает процесс. Никто не понимает‚ почему это произошло. Система просто выдает ошибку‚ не предоставляя никакой информации о причинах сбоя. Это классический пример проблемы «черного ящика». Непрозрачные системы затрудняют отладку‚ оптимизацию и‚ самое главное‚ порождают недоверие. В контексте регуляторов‚ непрозрачность может привести к неэффективному управлению‚ непредсказуемым результатам и даже к финансовым потерям.

Более того‚ «черные ящики» создают этические дилеммы. Если система принимает решения‚ влияющие на жизнь людей‚ важно понимать‚ как эти решения принимаются. Это особенно актуально в сферах‚ таких как кредитование‚ страхование и правосудие. Прозрачность моделей регуляторов позволяет выявить и устранить потенциальные предвзятости и дискриминационные практики.

Основные Подходы к Созданию Прозрачных Моделей

Существует несколько подходов‚ которые мы можем использовать‚ чтобы сделать модели регуляторов более прозрачными:

- Использование интерпретируемых моделей: Вместо сложных нейронных сетей‚ мы можем использовать более простые модели‚ такие как линейные регрессии‚ деревья решений или логистические регрессии.

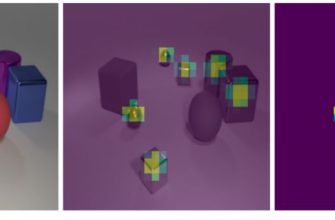

- Методы объяснимого ИИ (XAI): Даже если мы используем сложные модели‚ мы можем применять методы XAI‚ чтобы понять‚ какие факторы оказывают наибольшее влияние на принятые решения.

- Визуализация данных: Визуализация данных помогает нам увидеть закономерности и тенденции‚ которые могут быть скрыты в «сырых» данных.

- Аудит моделей: Регулярный аудит моделей позволяет выявить потенциальные проблемы и убедиться‚ что система работает в соответствии с заданными правилами.

Интерпретируемые Модели: Простота и Понятность

Интерпретируемые модели – это модели‚ которые легко понять и объяснить. Линейная регрессия‚ например‚ показывает‚ как каждая переменная влияет на целевую переменную. Деревья решений представляют собой иерархическую структуру‚ в которой каждое решение принимается на основе значения определенной переменной. Эти модели не обладают такой же предсказательной силой‚ как сложные нейронные сети‚ но они позволяют нам понять‚ как работает система.

При выборе интерпретируемой модели важно учитывать сложность задачи. Если задача относительно простая‚ линейной регрессии или дерева решений может быть достаточно. Если задача более сложная‚ можно использовать комбинацию нескольких интерпретируемых моделей или применять методы XAI к более сложным моделям.

Методы Объяснимого ИИ (XAI): Раскрываем Скрытое

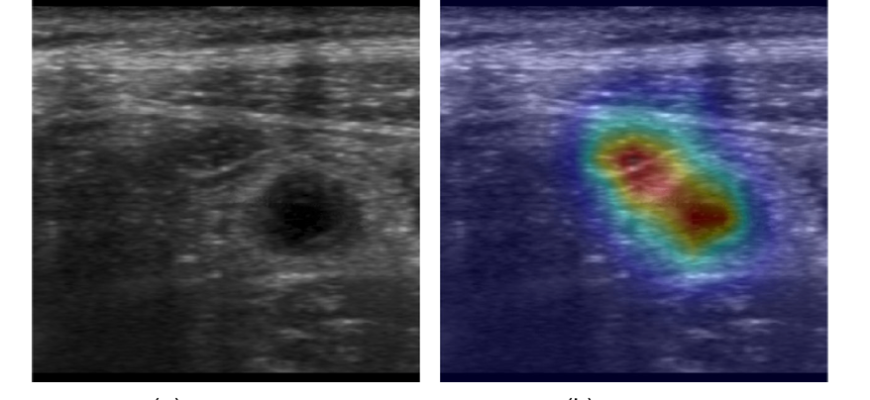

Методы XAI позволяют нам понять‚ как работают даже самые сложные модели. Эти методы включают:

- Важность признаков: Определение того‚ какие признаки оказывают наибольшее влияние на предсказания модели.

- Частичная зависимость: Визуализация того‚ как изменение значения определенного признака влияет на предсказания модели.

- LIME (Local Interpretable Model-agnostic Explanations): Объяснение предсказаний модели на локальном уровне‚ путем создания упрощенной модели‚ аппроксимирующей поведение сложной модели в окрестности определенной точки.

- SHAP (SHapley Additive exPlanations): Распределение влияния каждого признака на предсказание модели‚ используя значения Шепли из теории игр.

Использование методов XAI позволяет нам не только понять‚ как работает модель‚ но и выявить потенциальные проблемы‚ такие как предвзятости и ошибки в данных.

Визуализация Данных: Смотрим на Проблему с Другой Стороны

Визуализация данных – это мощный инструмент для понимания сложных систем. Графики‚ диаграммы и карты позволяют нам увидеть закономерности и тенденции‚ которые могут быть скрыты в таблицах с данными. Например‚ мы можем использовать графики рассеяния‚ чтобы увидеть‚ как две переменные связаны друг с другом‚ или гистограммы‚ чтобы увидеть распределение значений определенной переменной.

Визуализация данных также полезна для коммуникации. Хорошо продуманный график может быть более эффективным способом передачи информации‚ чем длинный отчет с цифрами. При создании визуализаций важно учитывать целевую аудиторию и выбирать наиболее подходящий тип графика для представления данных.

«Недостаточно получить правильный ответ. Надо понимать‚ как он был получен.»

⎼ Ричард Фейнман

Аудит Моделей: Регулярная Проверка Здоровья

Аудит моделей – это процесс регулярной проверки работы системы на соответствие заданным правилам и требованиям. Аудит включает в себя проверку данных‚ проверку кода‚ проверку производительности и проверку объяснимости. Важно проводить аудит регулярно‚ чтобы выявить потенциальные проблемы на ранних стадиях и убедиться‚ что система работает корректно.

Аудит моделей также важен для соблюдения нормативных требований. В некоторых отраслях‚ таких как финансовая и медицинская‚ существуют строгие правила‚ касающиеся прозрачности и объяснимости алгоритмов. Регулярный аудит помогает убедиться‚ что система соответствует этим требованиям.

Практические Советы по Созданию Прозрачных Регуляторов

Вот несколько практических советов‚ которые помогут нам создать более прозрачные регуляторы:

- Начните с простого: Начните с простых моделей и постепенно увеличивайте сложность‚ если это необходимо.

- Используйте методы XAI: Применяйте методы XAI‚ чтобы понять‚ как работают сложные модели.

- Визуализируйте данные: Создавайте визуализации‚ которые помогут вам увидеть закономерности и тенденции.

- Проводите аудит моделей: Регулярно проверяйте работу системы на соответствие заданным правилам.

- Документируйте все: Ведите подробную документацию по каждой модели‚ включая данные‚ код‚ результаты и объяснения.

- Привлекайте экспертов: Привлекайте экспертов из разных областей‚ чтобы получить различные точки зрения на проблему.

Примеры из Реальной Жизни

Рассмотрим несколько примеров из реальной жизни‚ когда создание прозрачных моделей регуляторов принесло значительные преимущества:

- Кредитный скоринг: Вместо использования сложных нейронных сетей для оценки кредитоспособности заемщиков‚ банки все чаще используют более простые модели‚ такие как логистическая регрессия. Это позволяет объяснить‚ почему конкретному заемщику было отказано в кредите.

- Медицинская диагностика: Врачи используют методы XAI‚ чтобы понять‚ как алгоритмы машинного обучения ставят диагнозы на основе медицинских изображений. Это помогает им убедиться в правильности диагноза и избежать ошибок.

- Автоматизированное управление производством: Инженеры используют визуализацию данных‚ чтобы отслеживать работу производственных линий и выявлять потенциальные проблемы на ранних стадиях.

Создание прозрачных моделей регуляторов – это сложная‚ но важная задача. «Черные ящики» порождают недоверие и затрудняют отладку и оптимизацию систем. Используя интерпретируемые модели‚ методы XAI‚ визуализацию данных и аудит моделей‚ мы можем сделать системы более понятными и эффективными. Это позволит нам не только улучшить работу регуляторов‚ но и повысить доверие к алгоритмам в целом.

Подробнее

| Интерпретируемые модели | XAI методы | Визуализация данных | Аудит моделей регуляторов | Прозрачность алгоритмов |

|---|---|---|---|---|

| Объяснимый ИИ | LIME SHAP | Этика алгоритмов | Предвзятость в моделях | Регуляторы машинного обучения |